SpringBoot整合ELK教程

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |

SpringBoot整合ELK教程

1 基础概念

ELK 即 Elasticsearch、Logstash、Kibana组合起来可以搭建线上日志系统本文主要讲解使用 ELK 来收集测试框架产生的日志。

- Elasticsearch用于存储收集到的日志信息

- Logstash用于收集日志测试框架应用整合了 Logstash 以后会把日志发送给 Logstash,Logstash再把日志转发给Elasticsearch

- Kibana通过Web端的可视化界面来查看日志。

2 通过docker compose搭建ELK环境

需要有docker环境:

docker安装教程

2.1 前置环境

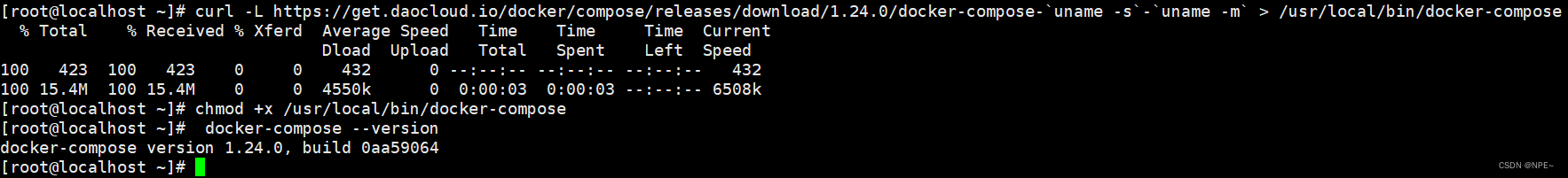

- 下载docker compose

Docker Compose是一个用于定义和运行多个docker容器应用的工具。使用Compose你可以用YAML文件来配置你的应用服务然后使用一个命令你就可以部署你配置的所有服务了。

管理docker的工具

curl -L https://get.daocloud.io/docker/compose/releases/download/1.24.0/docker-compose-`uname -s`-`uname -m` > /usr/local/bin/docker-compose

- 修改文件为可执行

chmod +x /usr/local/bin/docker-compose

- 查看是否安装成功

docker-compose --version

4. 下载docker有关镜像

docker pull elasticsearch:7.6.2

docker pull logstash:7.6.2

docker pull kibana:7.6.2

2.2 正式搭建docker

①创建配置文件

- 创建文件夹

mkdir -p /mydata/logstash

cd /mydata/logstash

- 编写配置文件

logstash-springboot.conf

vim logstash-springboot.conf

配置文件内容:

input {

tcp {

mode => "server"

host => "0.0.0.0"

port => 4560

codec => json_lines

}

}

output {

elasticsearch {

hosts => "es:9200"

index => "springboot-logstash-%{+YYYY.MM.dd}"

}

}

②创建脚本启动ELK

vim docker-compose.yml

version: '3'

services:

elasticsearch:

image: elasticsearch:7.6.2

container_name: elasticsearch

user: root

environment:

- "cluster.name=elasticsearch" #设置集群名称为elasticsearch

- "discovery.type=single-node" #以单一节点模式启动

- "ES_JAVA_OPTS=-Xms512m -Xmx512m" #设置使用jvm内存大小

volumes:

- /mydata/elasticsearch/plugins:/usr/share/elasticsearch/plugins #插件文件挂载

- /mydata/elasticsearch/data:/usr/share/elasticsearch/data #数据文件挂载

ports:

- 9200:9200

- 9300:9300

logstash:

image: logstash:7.6.2

container_name: logstash

environment:

- TZ=Asia/Shanghai

volumes:

- /mydata/logstash/logstash-springboot.conf:/usr/share/logstash/pipeline/logstash.conf #挂载logstash的配置文件

depends_on:

- elasticsearch #kibana在elasticsearch启动之后再启动

links:

- elasticsearch:es #可以用es这个域名访问elasticsearch服务

ports:

- 4560:4560

kibana:

image: kibana:7.6.2

container_name: kibana

links:

- elasticsearch:es #可以用es这个域名访问elasticsearch服务

depends_on:

- elasticsearch #kibana在elasticsearch启动之后再启动

environment:

- "elasticsearch.hosts=http://es:9200" #设置访问elasticsearch的地址

ports:

- 5601:5601

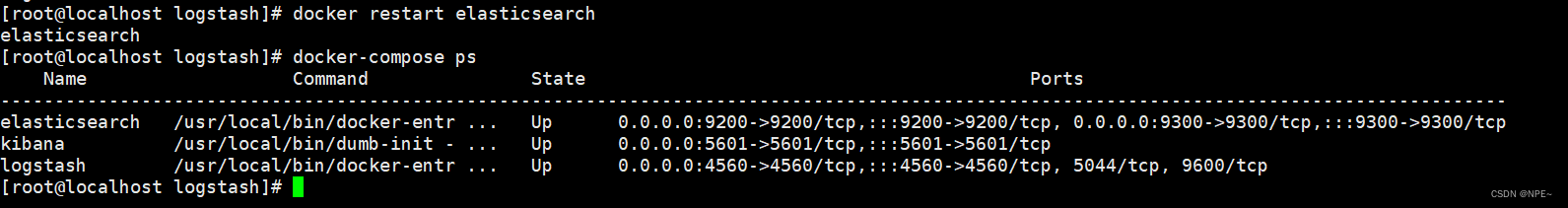

③启动脚本

docker-compose up -d

如果启动时出错没有权限添加权限执行权限即可

chmod 777 /mydata/elasticsearch/data/

如果elasticsearch如上图一样没有启动起来重启即可因为启动时间需要比较久

docker restart elasticsearch

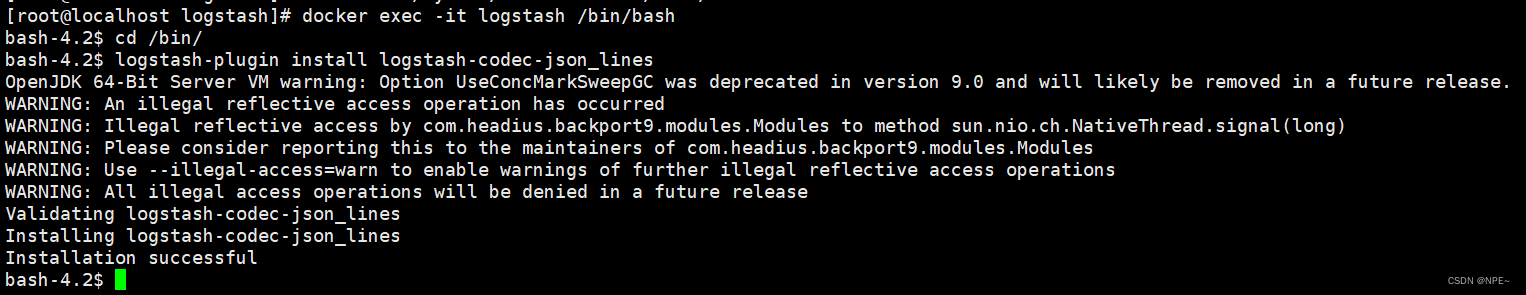

④在 logstash 中安装 json_lines 插件

# 进入logstash容器

docker exec -it logstash /bin/bash

# 进入bin目录

cd /bin/

# 安装插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 重启logstash服务

docker restart logstash

安装时间可能比较久需要耐心等待

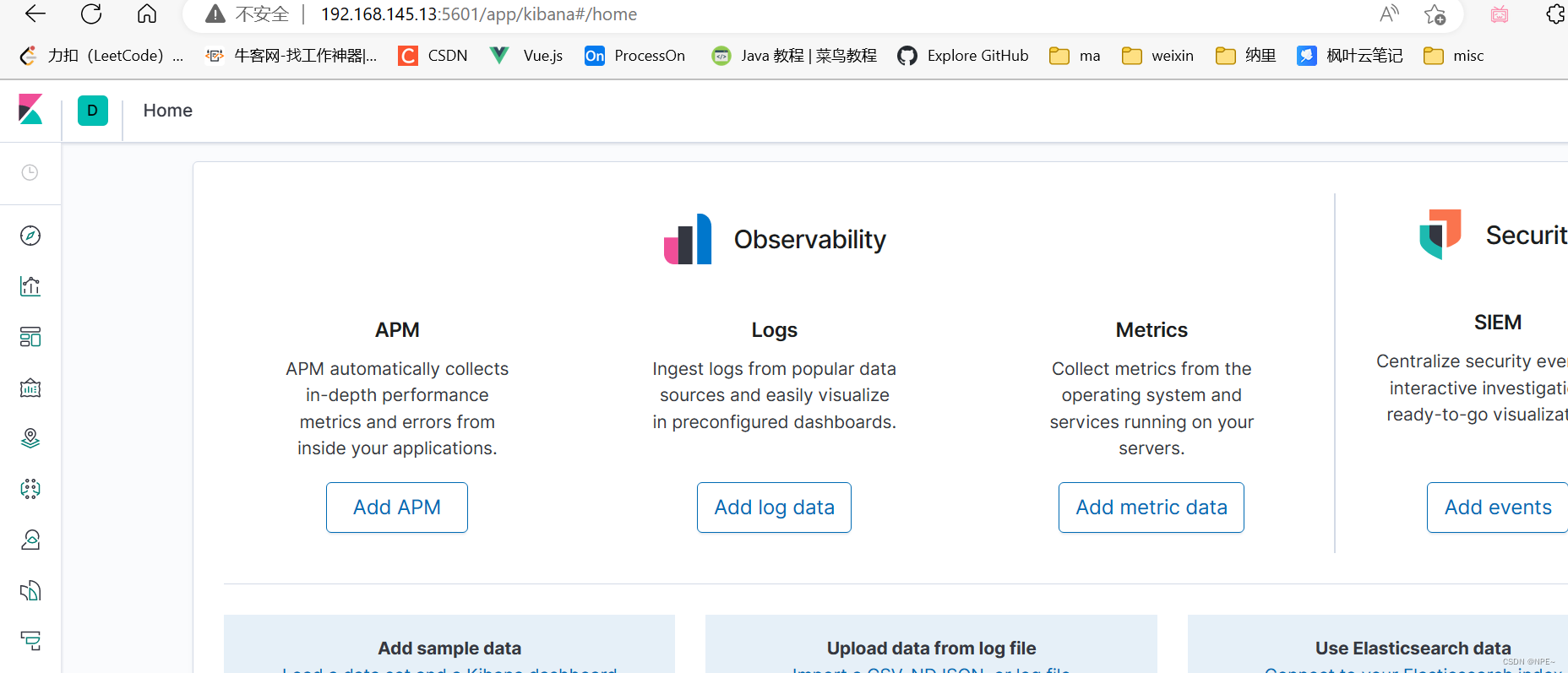

⑤关闭防火墙查看kibana结果

systemctl stop firewalld

访问地址

# ip改成自己的即可

http://192.168.145.13:5601/

bug

- 如果访问kibana地址出现如下错误

Kibana server is not ready yet

解决方法

方法一

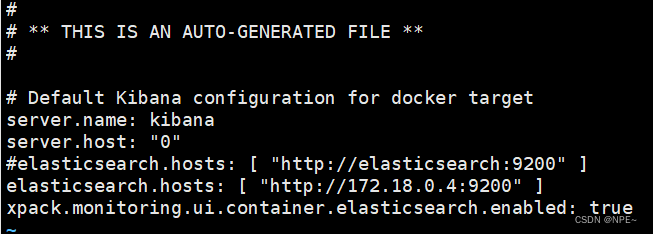

将配置文件kibana.yml中的elasticsearch.url改为正确的链接默认为: http://elasticsearch:9200改为http://自己的IP地址:9200【改成自己的ip】

# 查看本机ip

ip address

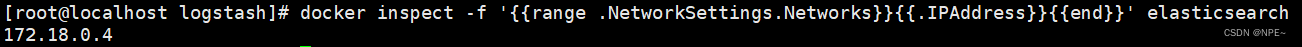

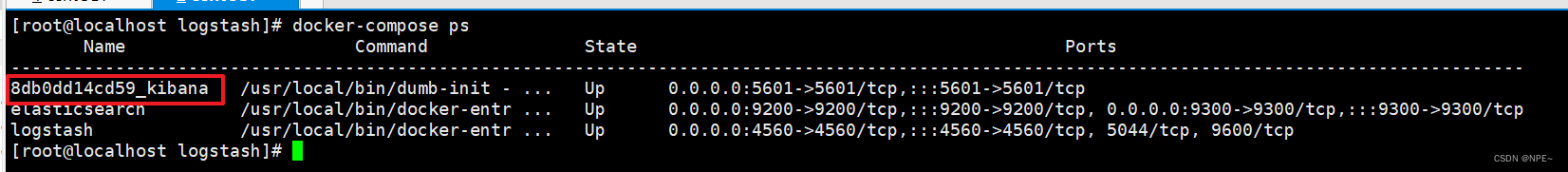

①查看es内部容器ip

# 查看elasticsearch内部容器ip

docker inspect -f '{{range .NetworkSettings.Networks}}{{.IPAddress}}{{end}}' elasticsearch

# 172.18.0.4

②进入kibana容器修改配置文件

# 进入 Kibana 容器内部修改 kibana.yml 中的ip

# docker ps 查看kibana容器名

docker exec -it kibana容器id /bin/bash

# docker exec -it 8db0dd14cd59_kibana /bin/bash

# 修改配置文件

cd config

vi kibana.yml

# 只需要将上面的 "http://elasticsearch:9200"中的

#elasticsearch 替换成上一步的es容器内部ip就可以了。

③退出kibana容器并重启kibana

exit

docker restart kibana容器名

# docker restart 8db0dd14cd59_kibana

方法二

关闭防火墙

systemctl stop firewalld

# 查看防火墙状态是否关闭成功

systemctl status firewalld

#永久关闭防火墙

# systemctl disable firewalld.service

# 重启docker

systemctl restart docker

#重启docker服务

docker-compose up -d

方法三

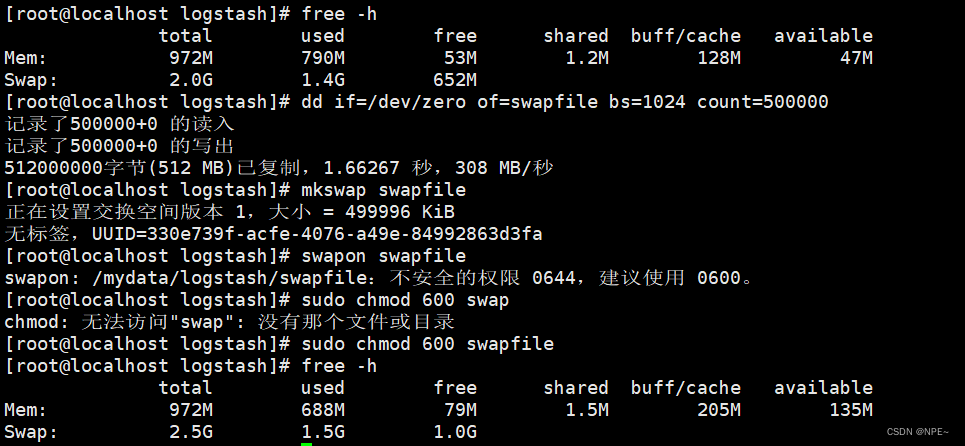

服务器内存不够

# 查看内存使用情况

free -h

设置swap

- 创建swapfile# dd if=/dev/zero of=swapfile bs=1024 count=500000 of是空间名称count是空间大小,bs是单位这里是kb,你可以将bs=1024改为bs=1G后面的count就可以改为count=2,就是创建2G大小的swap文件

- 将swapfile设置为swap空间# mkswap swapfile

- 启用交换空间: # swapon swapfile 删除交换空间命令 swapoff swapfile

如果提示不安全则使用

sudo chmod 600 swapfile

- 再用free -h命令查看内存情况就会发现Swap中的内存增加了

方法四

看自己是否开启了VPN或者代理关闭之后重新打开浏览器访问即可

最后测试

# 输入自己服务器的ip(我的是192.168.145.13:5601)

http://192.168.145.13:5601/

成功访问

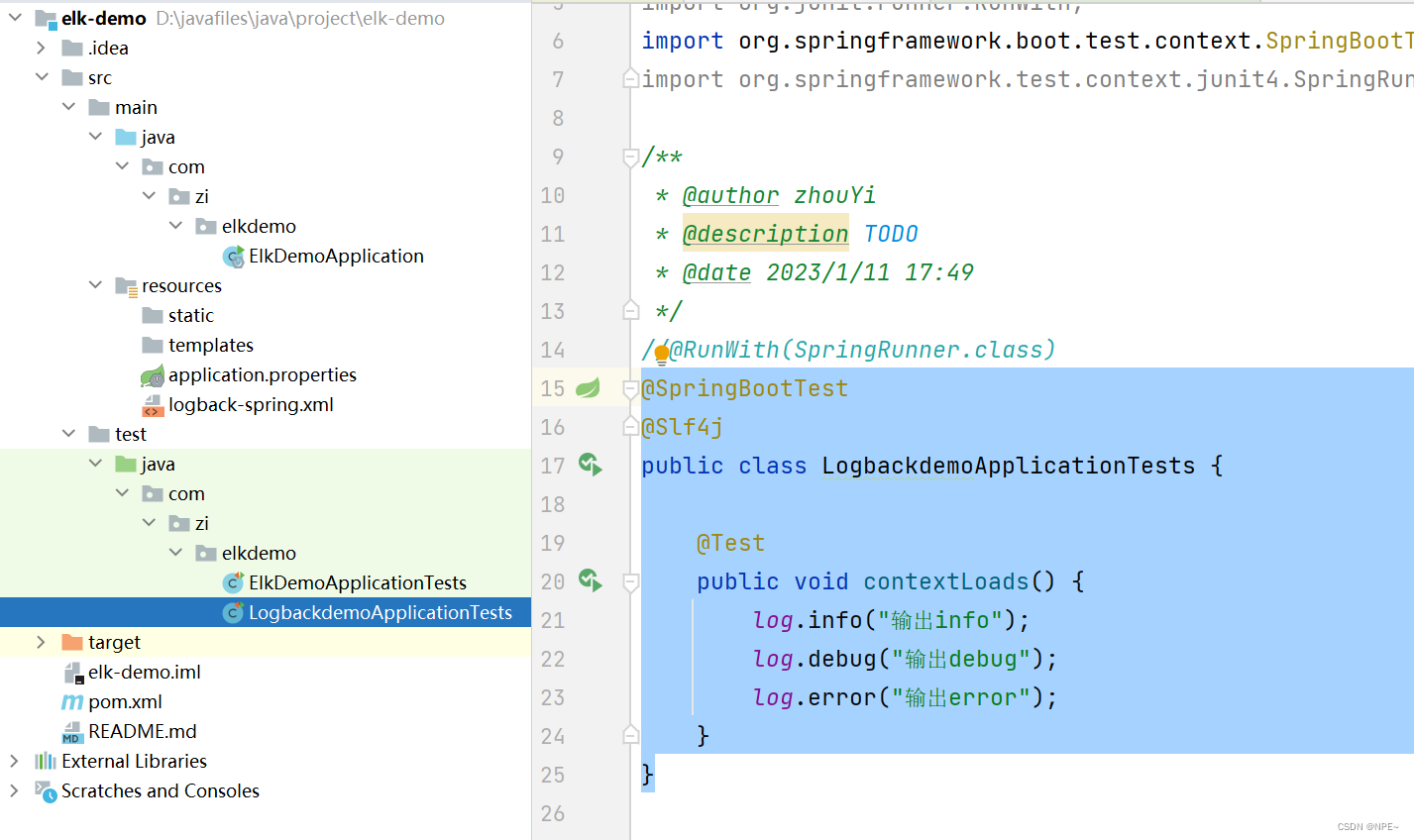

2.3 SpringBoot框架集成logstash

项目结构

①pom.xml添加依赖

<!--集成logstash-->

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>5.3</version>

</dependency>

完整pom文件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.6.11</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<groupId>com.zi</groupId>

<artifactId>elk-demo</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>elk-demo</name>

<description>elk-demo</description>

<properties>

<java.version>1.8</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!--引入logstash收集日志-->

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>5.3</version>

</dependency>

<dependency>

<!--方便打印日志-->

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>1.18.12</version>

</dependency>

<dependency>

<!--方便测试-->

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.13</version>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.8.1</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

<encoding>UTF-8</encoding>

</configuration>

</plugin>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>

②添加配置文件 logback-spring.xml

让 logback 的日志输出到 logstash

注意 appender 节点下的 destination 需要改成你自己的 logstash 服务地址比如我的是192.168.145.13:4560 。

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration>

<include resource="org/springframework/boot/logging/logback/defaults.xml"/>

<include resource="org/springframework/boot/logging/logback/console-appender.xml"/>

<!--应用名称-->

<property name="APP_NAME" value="springboot-logback-elk-demo"/>

<!--日志文件保存路径-->

<property name="LOG_FILE_PATH" value="${LOG_FILE:-${LOG_PATH:-${LOG_TEMP:-${java.io.tmpdir:-/tmp}}}/logs}"/>

<contextName>${APP_NAME}</contextName>

<!--每天记录日志到文件appender-->

<appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>${LOG_FILE_PATH}/${APP_NAME}-%d{yyyy-MM-dd}.log</fileNamePattern>

<maxHistory>30</maxHistory>

</rollingPolicy>

<encoder>

<pattern>${FILE_LOG_PATTERN}</pattern>

</encoder>

</appender>

<!--输出到logstash的appender-->

<appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<!--可以访问的logstash日志收集端口-->

<destination>192.168.145.13:4560</destination>

<encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/>

</appender>

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="FILE"/>

<appender-ref ref="LOGSTASH"/>

</root>

</configuration>

③运行测试

测试类

@SpringBootTest

@Slf4j

public class LogbackdemoApplicationTests {

@Test

public void contextLoads() {

log.info("输出info");

log.debug("输出debug");

log.error("输出error");

}

}

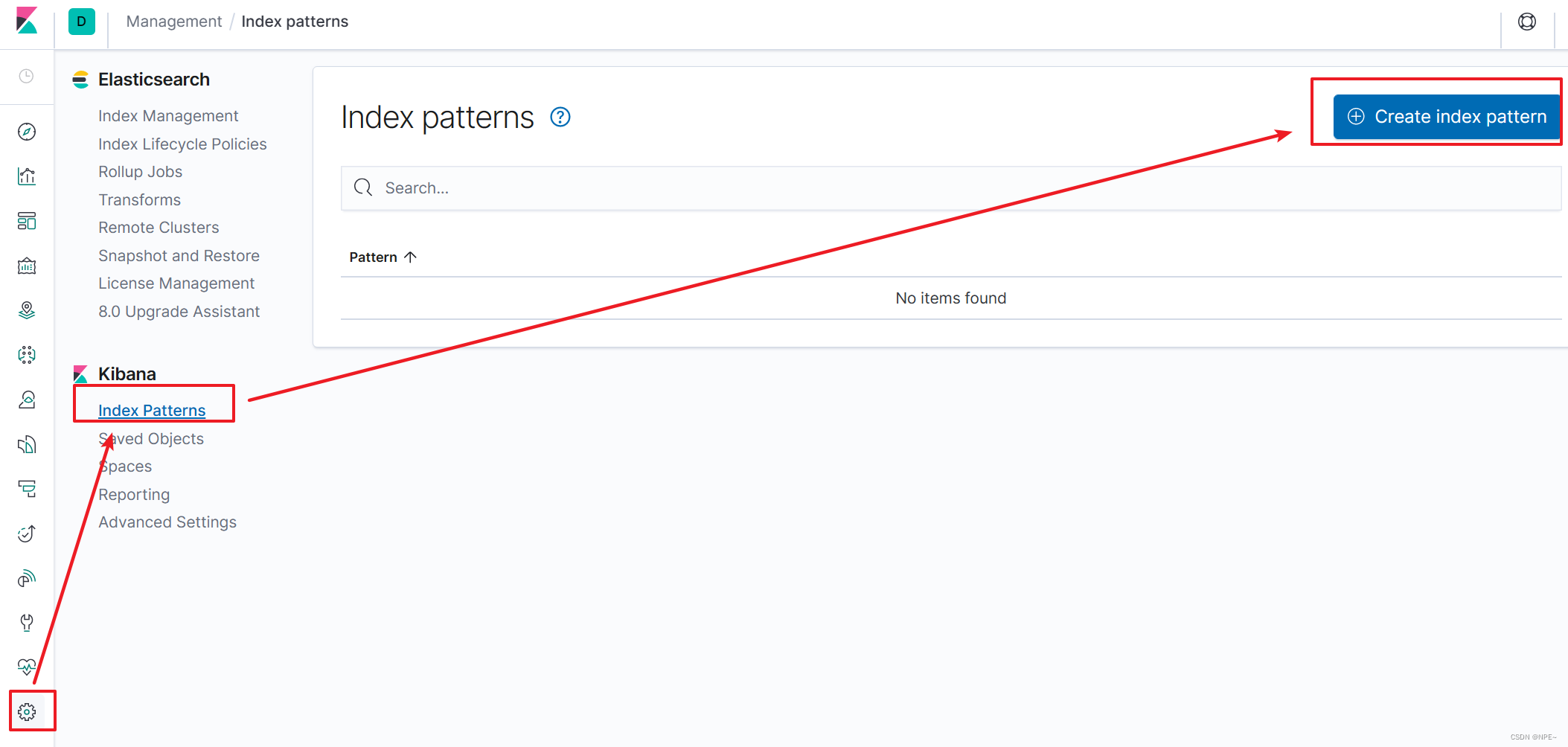

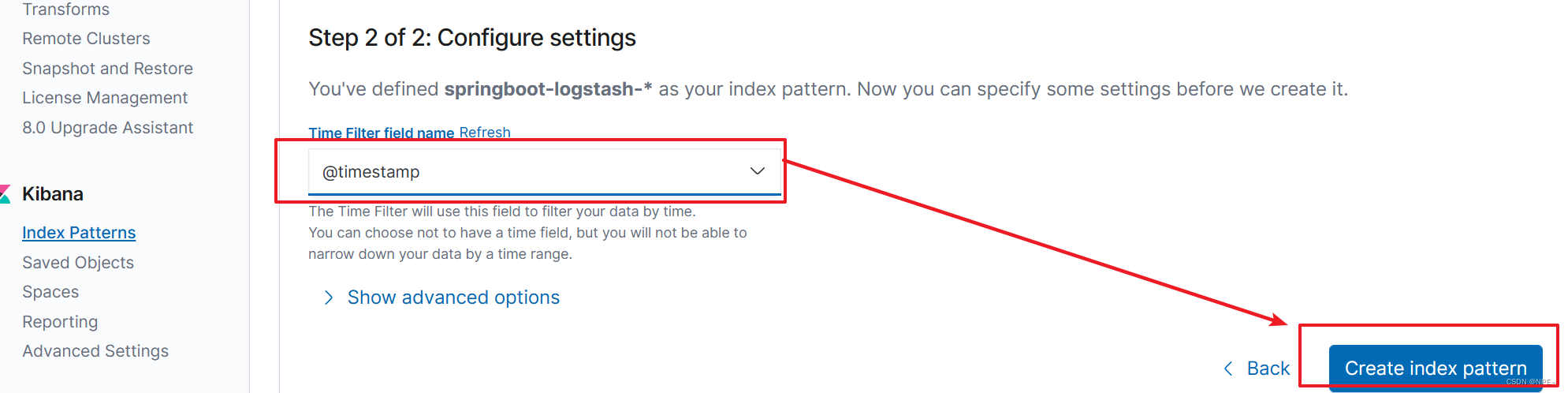

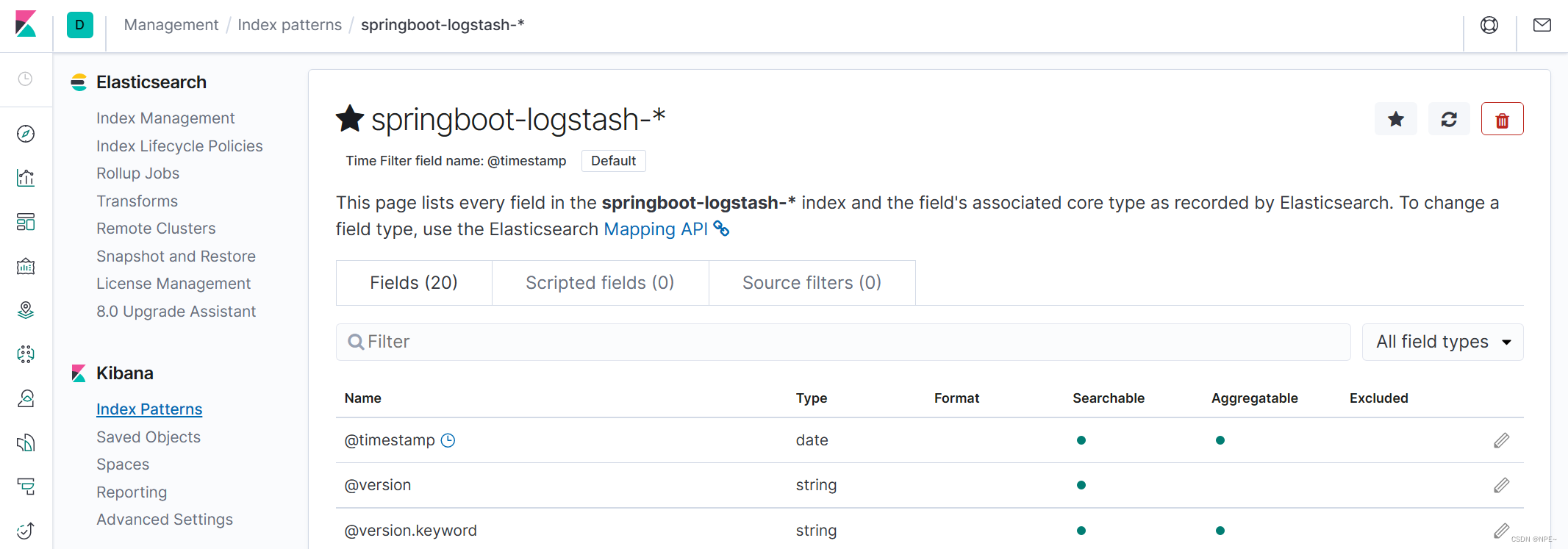

2.4 使用kibana

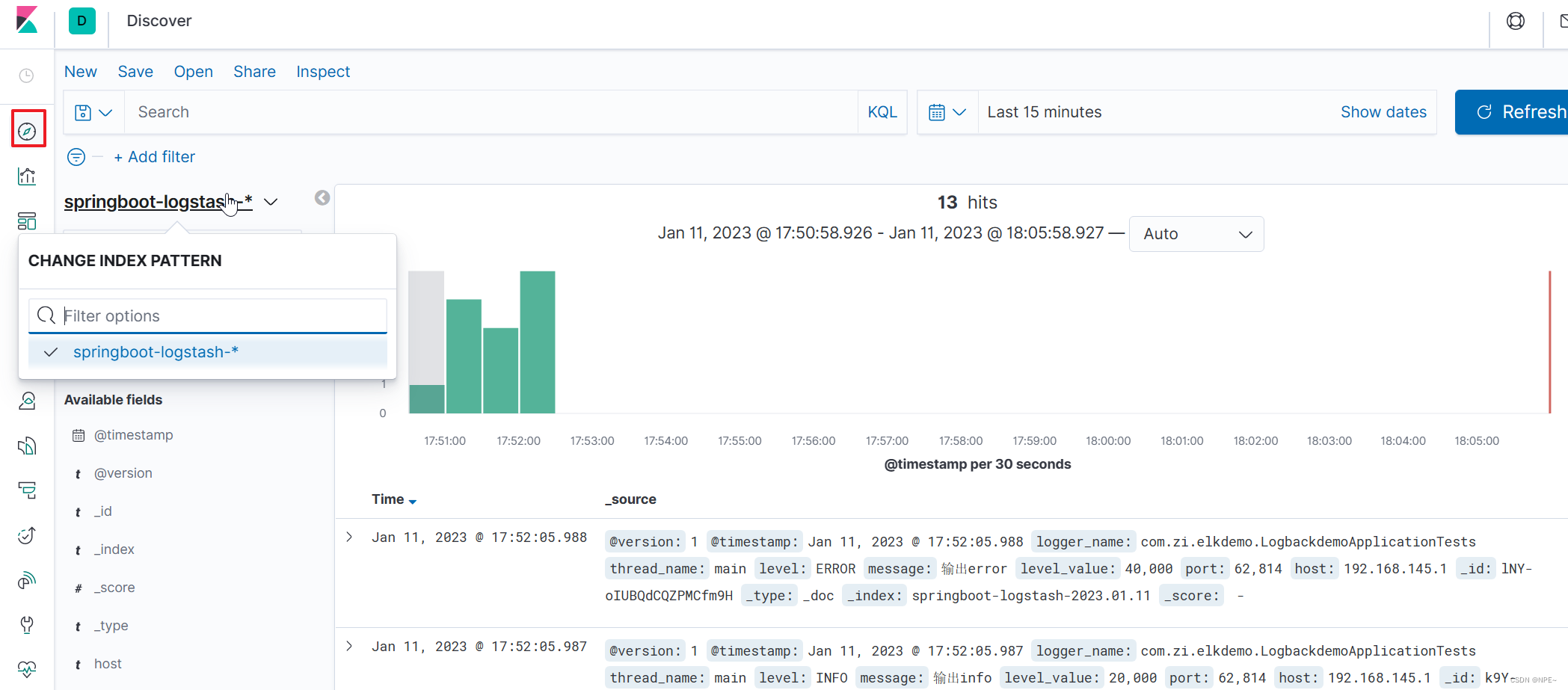

-

创建 index pattern

成功创建

-

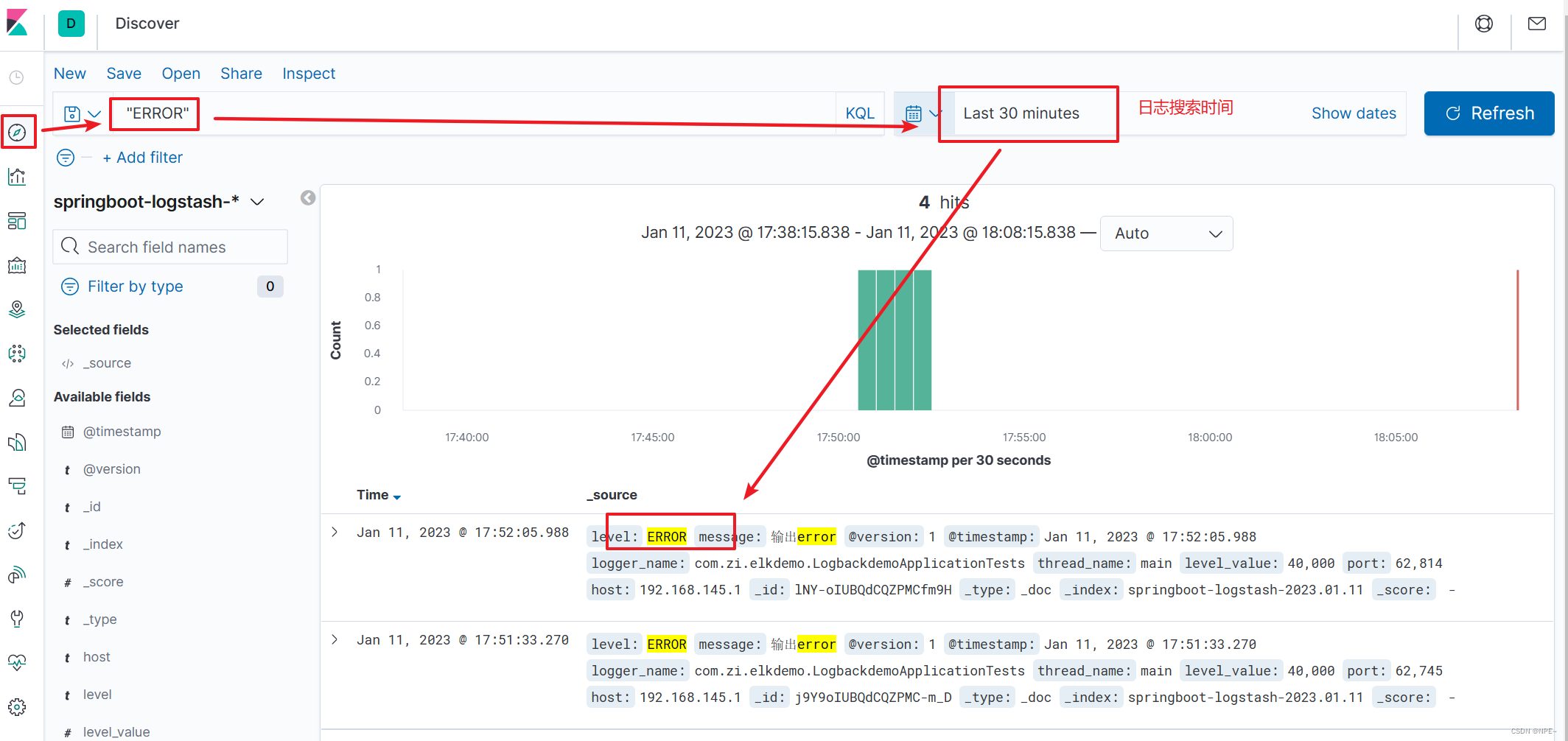

查看收集的日志

-

筛选日志

-

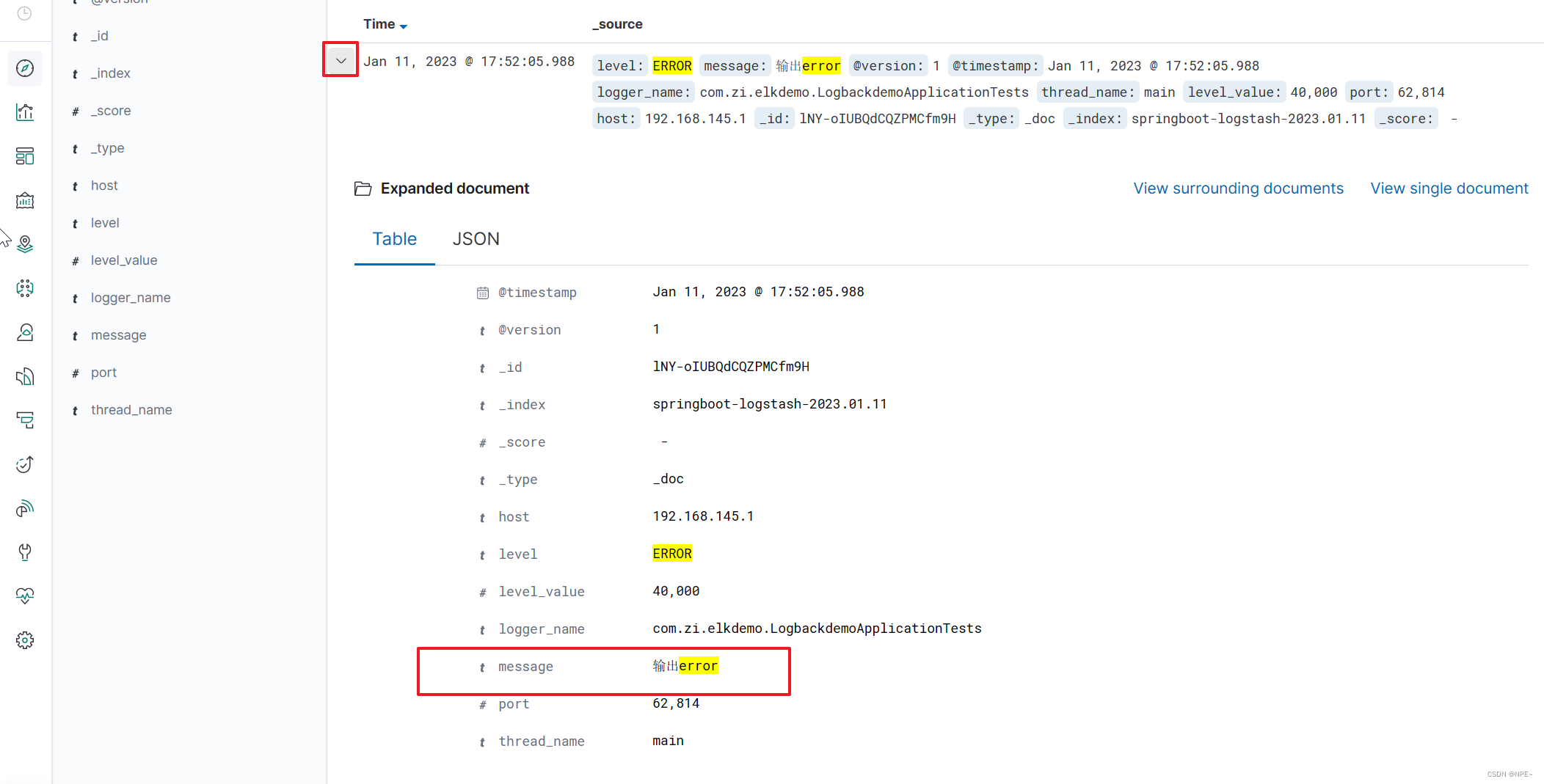

查看日志详情

搭建了 ELK 日志收集系统之后我们如果要查看测试框架的日志信息就不需要查看日志文件了直接 在Kibana 中查看即可。

参考文章

https://cloud.tencent.com/developer/article/1704647?from=article.detail.1468662