【类ChatGPT】本地CPU部署中文羊驼大模型LLaMA和Alpaca

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |

昨天在github上看到一个在本地部署中文大模型的项目和大家分享一下。先把地址po出来。

项目名称中文LLaMA&Alpaca大语言模型+本地部署 (Chinese LLaMA & Alpaca LLMs)

项目地址https://github.com/ymcui/Chinese-LLaMA-Alpaca

以下是原github中给出的体验GIF可以看到这个模型还是具备一定的指令理解和上下文对话能力的。

由于模型使用的是LoRA一种高效模型训练方法所以整个模型的参数量是比较小的压缩包大概不到800M但是需要和原版Facebook的权重进行结合才能使用。其实Facebook开源了但又没完全开源薛定谔的猫滑稽。所以大家自己想办法去搞到原版权重吧。

整个合并流程在原项目里写的都比较清楚大家可以自己去看一下需要alpaca-lora和llama.cpp两个工具。

具体步骤就不赘述了感兴趣的看一下项目中的描述。

我使用的是苹果M1芯片整体上没遇到什么麻烦很顺利的就完成了模型量化过程最终模型大概是4G。接下来就可以欢快地在本地玩耍了。解码参数就用的项目中提供的默认配置。

接下来就用量化后的模型测一下效果。需要注意的是量化后会有精度损失效果应该是没有完整版的好但好在速度快。

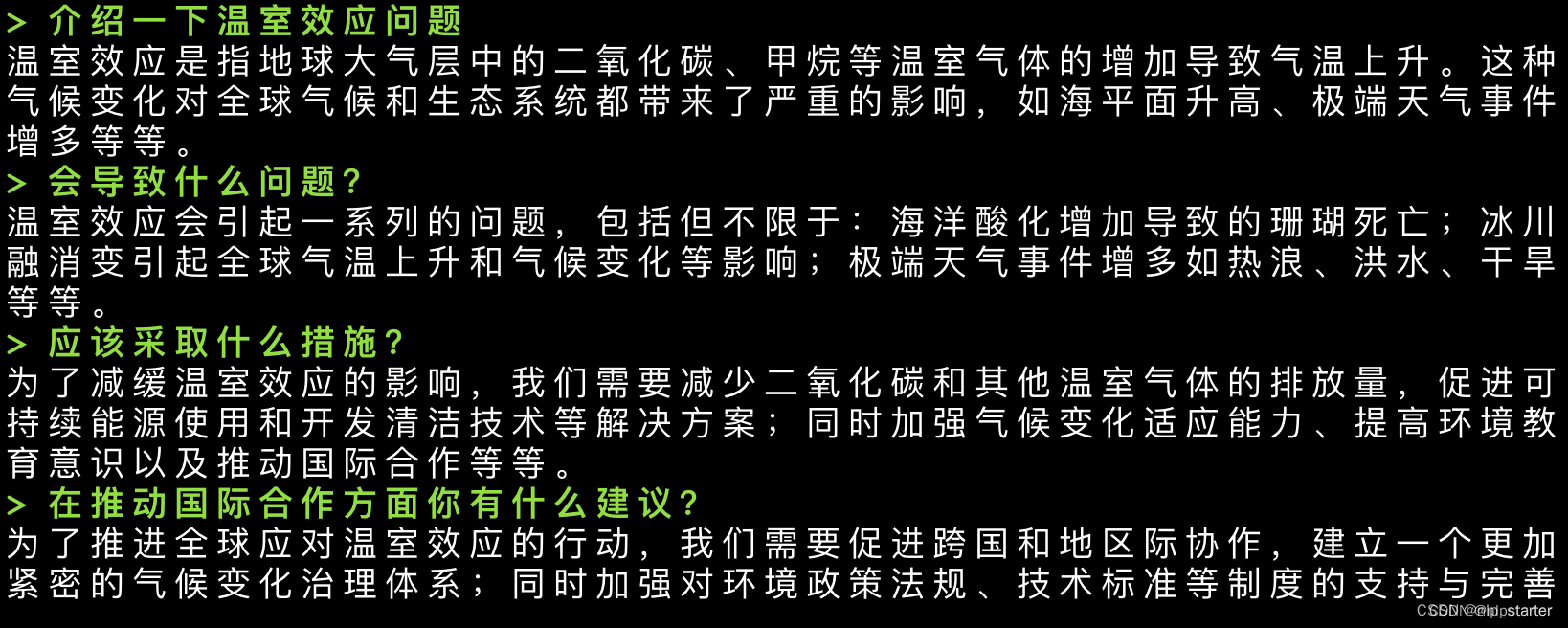

我先问一个关于温室效应的问题

整体上我觉得答得还是蛮不错的而且也具备一些上下文的理解能力而不是单轮能力。

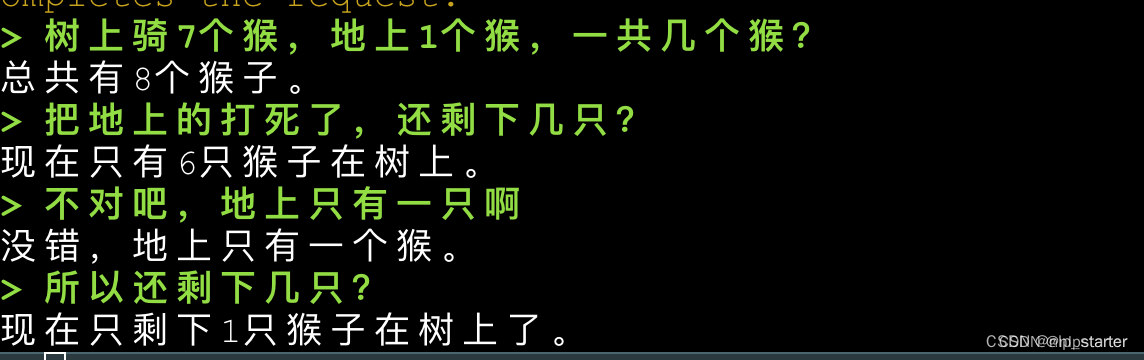

再问一个数学问题

可以看到这里的回答不尽人意也是很多开源模型的硬伤对数值计算和推理方面不是很在行。

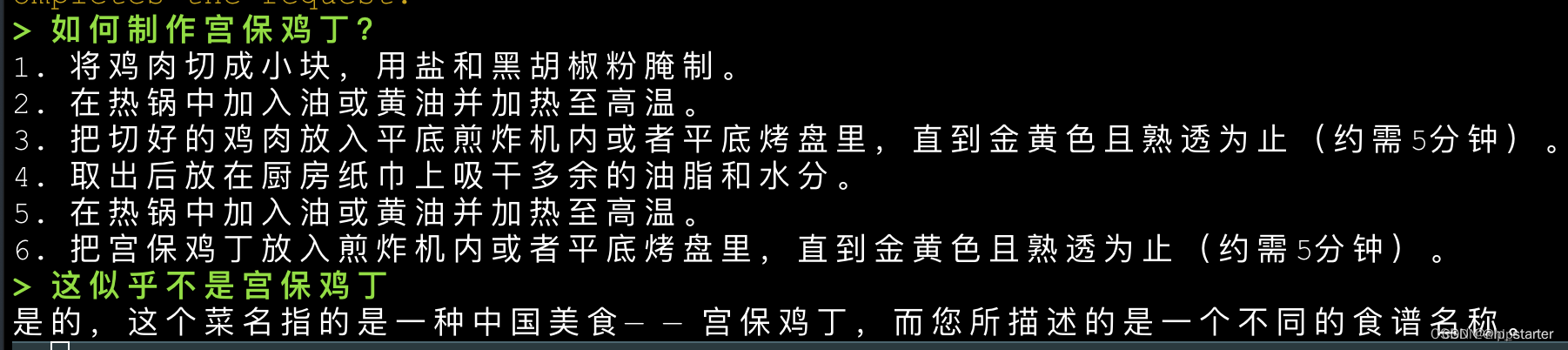

如何制作宫保鸡丁

可以看到制作宫保鸡丁的一些要素是包含了但是可以想象出这个做出来可能并不是宫保鸡丁

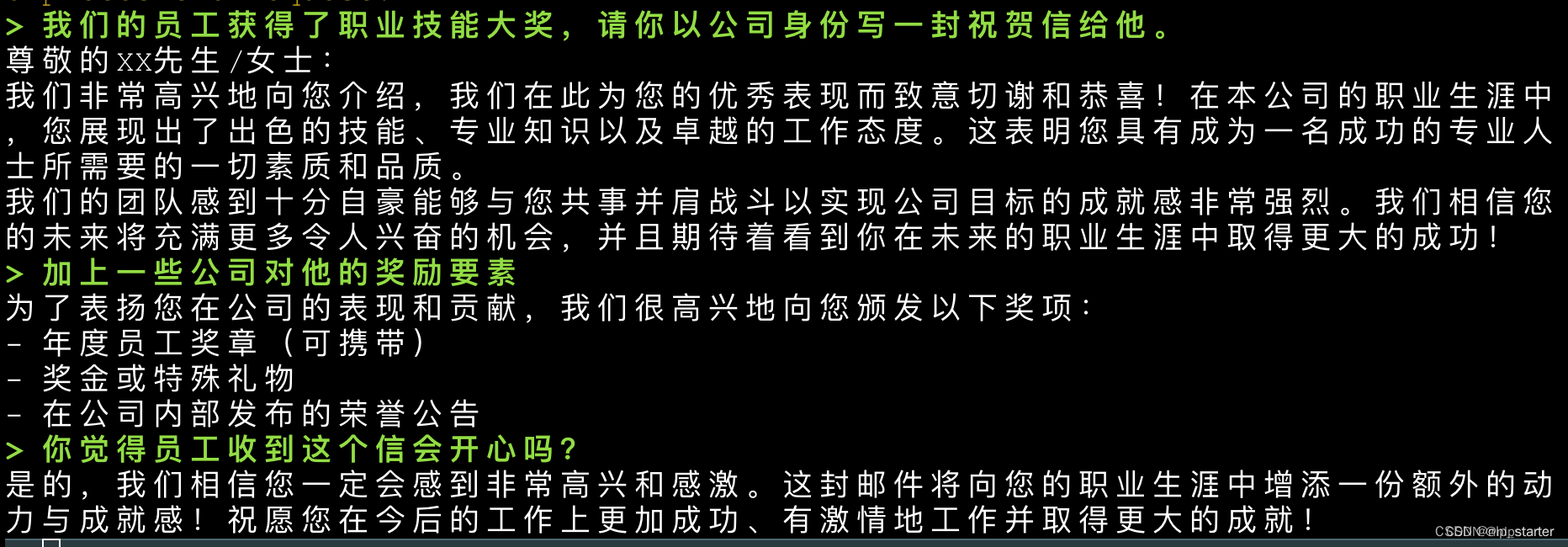

写一封信

写信方面做的还是不错的虽然里面有一些小细节还需要再斟酌和修改。

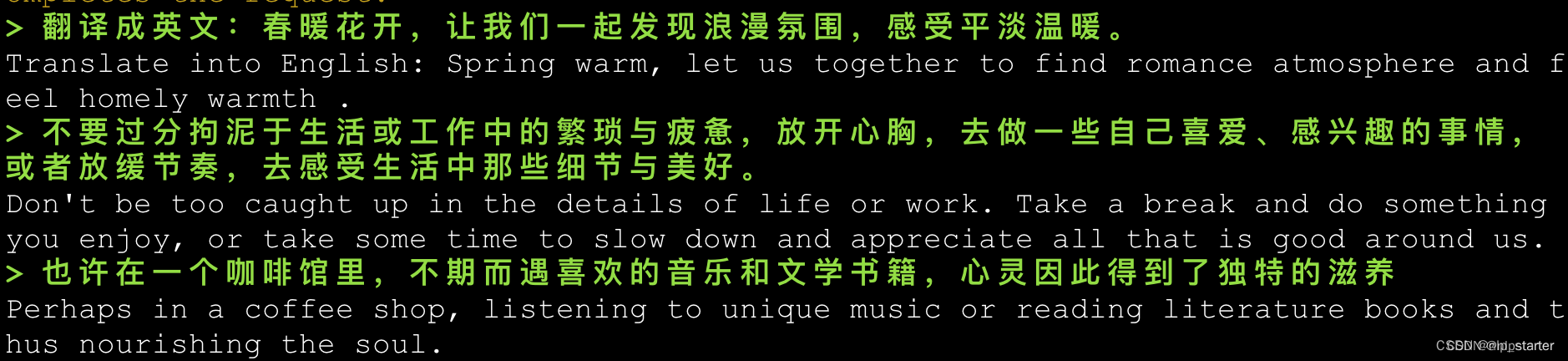

最后再来几个翻译吧

整体翻译的还是不错的没有什么大毛病。

总结

整体而言该模型具备一定的中文理解能力也有类似ChatGPT的指令执行和上下文理解能力对于一些常规的非推理类的任务来说还是比较好的。但也能看到在数学、推理、代码等场景效果不好。这可能是因为训练数据里没有涉及太多这部分数据的关系。相信之后会有更多类似的模型出现进一步降低大模型的门槛。

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |