Ubuntu上安装 Spark3.3与Scala2.13的过程

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |

解压文件

sudo tar -zxvf scala-2.13.7.tgz -C /usr/local/

sudo mv ./scala-2.13.7/ ./scala

/etc/profile或者 ~/.bashrc 配置环境变量

sudo vim /etc/profile

或者

sudo vim ~/.bashrc

在最后添加配置内容

export SCALA_HOME=/usr/local/scala

export PATH=${SCALA_HOME}/bin:$PATH

使变量生效

source /etc/profile

或者

source ~/.bashrc

注/etc/profile 用于所有用户变量 ~/.bashrc 用于当前用户

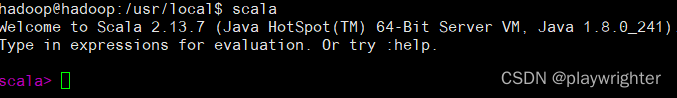

执行scala进入:quit退出

解压文件

sudo tar -zxvf spark-3.3.1-bin-hadoop3.2.tgz -C /usr/local/

sudo mv ./spark-3.3.1-bin-hadoop3/ ./spark

sudo chown -R hadoop:hadoop ./spark

/etc/profile或者 ~/.bashrc 配置环境变量

sudo vim /etc/profile

或者

sudo vim ~/.bashrc

在最后添加配置内容

export SPARK_HOME=/usr/local/spark

export PATH=${SPARK_HOME}/bin:$PATH

使配置生效

source /etc/profile

或者

source ~/.bashrc

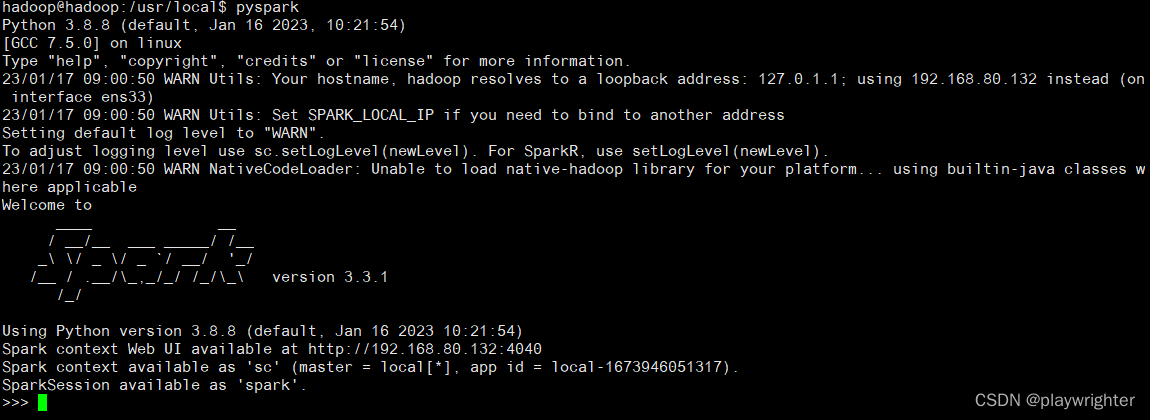

执行pyspark进入Ctrl+D 或者 exit() 退出

全分布式的集群通过scp复制

scp -r -f /home/hadoop/ hadoop@192.168.80.132:/hadoop/