sklearn交叉验证函数cross_cross_val_score参数

阿里云国际版折扣https://www.yundadi.com |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |

文章目录

一 、使用示例

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn import svm

from sklearn.model_selection import cross_val_score

target=odata["target"]

X=odata.drop(columns="target")

clf = svm.SVC(kernel='linear', C=1)

scores = cross_val_score(clf,X,target, cv=5,scoring = "neg_mean_squared_error")

cross_val_score(estimator, X, y,, scoring=None, cv=None, n_jobs=None, verbose=0, fit_params=None, pre_dispatch="2*n_jobs")

二、参数含义

| 参数 | 解释 | 取值 |

|---|---|---|

| estimator | 使用的模型实例 | 实例化模型SVM,XGBoostDBDT |

| X, y | 自变量标签值 | 数据集 |

| soring | 评估效果 | 取值下表详述 |

| cv | 交叉验证时迭代次数 | 整数 |

| n_jobs | 同时工作的cpu个数-1代表全部 | [-1,1,2…] |

| verbose | 日志冗长度 | - |

| int | 冗长度 | 0不输出训练过程1偶尔输出>1对每个子模型都输出 |

| fit_params | 传递给估计器的拟合方法的参数 | - |

| pre_dispatch | 控制并行执行期间调度的作业数量。减少这个数量对于避免在CPU发送更多作业时CPU内存消耗的扩大是有用的。 | “2*n_jobs”/数值 |

三、常见的scoring取值

下两个网址可以帮助理解

https://zhuanlan.zhihu.com/p/509437755

https://scikit-learn.org/stable/modules/model_evaluation.html#scoring-parameter

| 取值 | 含义 |

|---|---|

| ‘accuracy’ | 准确度 |

| ‘precision’ | 精度 |

| ‘f1’ | f1_score对于二进制目标 |

| ‘f1_micro’ | 微观F1 |

| ‘f1_macro’ | 宏F1二分类使用Accuracy和F1-score多分类使用Accuracy和宏F1。 |

| ‘recall’ | 召回率 |

| ‘roc_auc’ | AUC值 |

| neg_log_loss | neg_log_loss损失结果越接近0表示损失越小模型效果越好,对数似然函数 Log_loss是一种直接根据概率预测结果衡量损失的函数和逻辑回归中的损失函数类似。对数似然函数直接指向模型最优化方向对于那些以最优化为目的求解模型的算法来说会天然有较好的得分。比如逻辑回归、svm等其中逻辑回归的损失函数就是对数似然。 |

| ‘r2’ | R方越大越好,R^2可以为负 |

| neg_mean_squared_error | 负均值平方误差负数越小越好均方误差MSE的数值其实就是neg_mean_squared_error去掉负号的数字 |

| neg_mean_absolute_error | 负绝对均值误差MAE的负取值现实中MSE和MAE选一个来使用就好了 |

1.分类、回归和聚类scoring参数选择

分类问题一般选择‘roc_auc’、‘neg_log_loss’、‘f1’等根据实际需求选择。

回归问题一般选择‘neg_mean_absolute_error、neg_mean_squared_error、‘r2’等 根据实际需求选择。

聚类adjusted_rand_score、completeness_score等

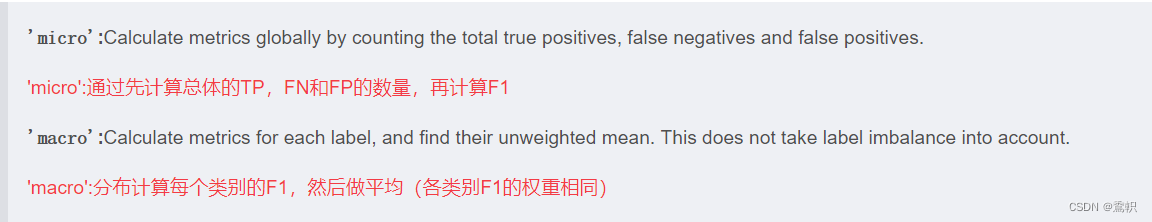

2.f1_micro和f1_macro区别

3.负均方误差和均方误差

虽然均方误差永远为正但是sklearn中的参数scoring下均方误差作为评判标准时却是计算”负均方误差“neg_mean_squared_error。这是因为sklearn在计算模型评估指标的时候会考虑指标本身的性质均方误差本身是一种误差所以被sklearn划分为模型的一种损失(loss)。在sklearn当中所有的损失都使用负数表示因此均方误差也被显示为负数了。真正的均方误差MSE的数值其实就是neg_mean_squared_error去掉负号的数字。