决策树-入门-CSDN博客

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |

1、认识决策树

决策树思想的来源非常朴素程序设计中的条件分支结构就是if-then结构最早的决策树就是利用这类结构分割数据的一种分类学习方法

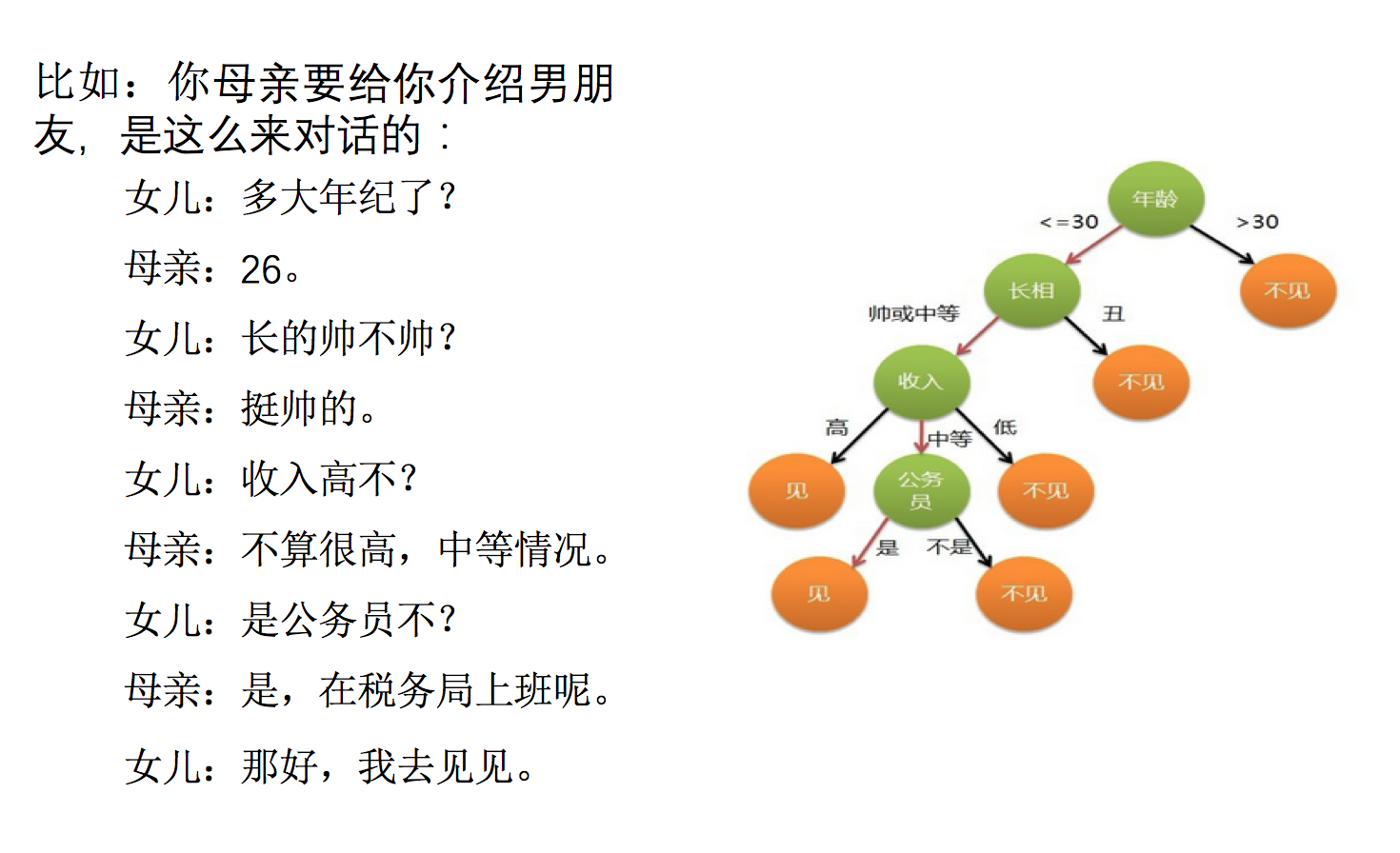

怎么理解这句话通过一个对话例子

想一想这个女生为什么把年龄放在最上面判断

2、决策树分类原理详解

为了更好理解决策树具体怎么分类的我们通过一个问题例子

问题如何对这些客户进行分类预测你是如何去划分

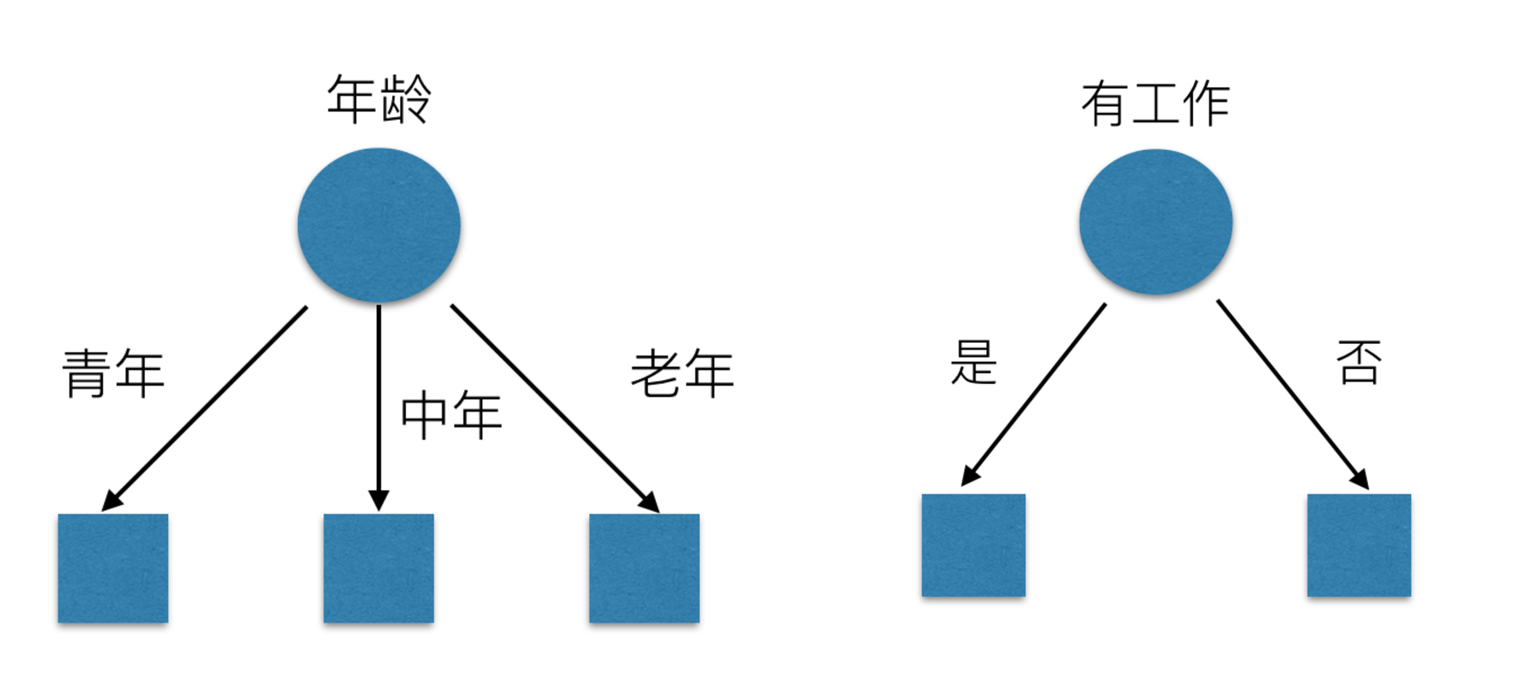

有可能你的划分是这样的

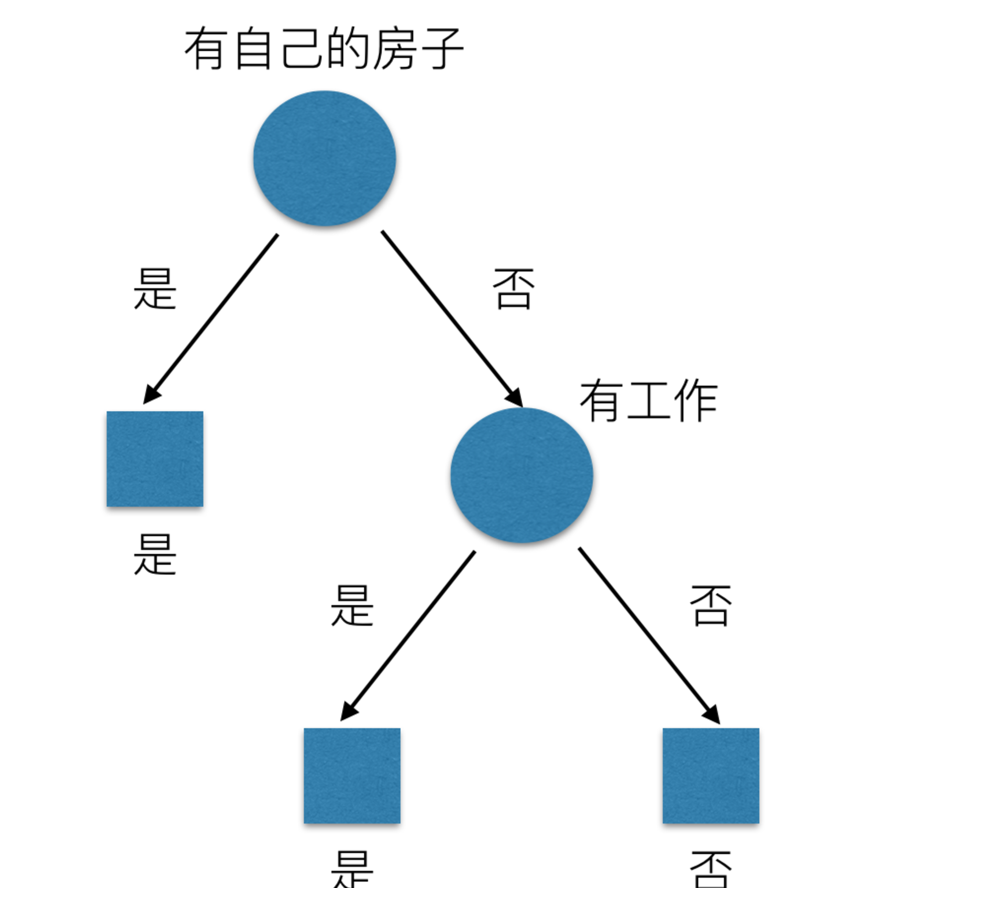

那么我们怎么知道这些特征哪个更好放在最上面那么决策树的真是划分是这样的

2.1 原理

- 信息熵、信息增益等

需要用到信息论的知识问题通过例子引入信息熵

2.2 信息熵

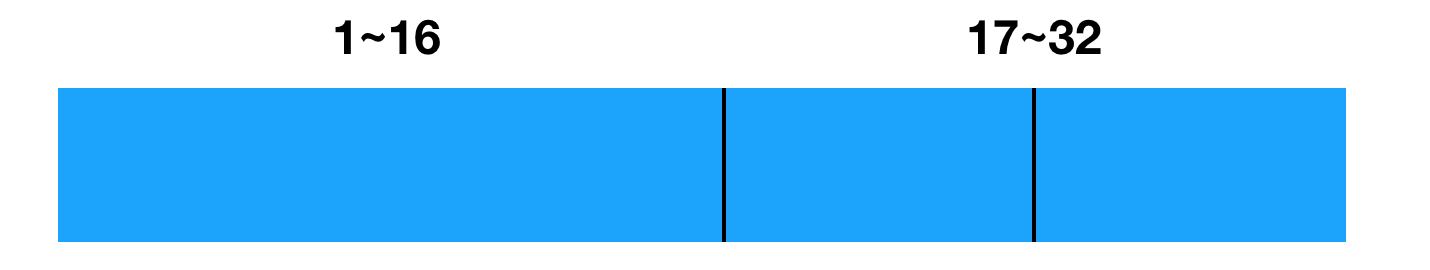

那来玩个猜测游戏猜猜这32支球队那个是冠军。并且猜测错误付出代价。每猜错一次给一块钱告诉我是否猜对了那么我需要掏多少钱才能知道谁是冠军 前提是不知道任意球队的信息、历史比赛记录、实力等

为了使代价最小可以使用二分法猜测

我可以把球编上号从1到32然后提问冠 军在1-16号吗依次询问只需要五次就可以知道结果。

我们来看这个式子

- 32支球队log32=5比特

- 64支球队log64=6比特

香农指出它的准确信息量应该是p为每个球队获胜的概率假设概率相等都为1/32我们不用钱去衡量这个代价了香浓指出用比特

H = -(p1logp1 + p2logp2 + … + p32log32) = - log32

2.2.1 信息熵的定义

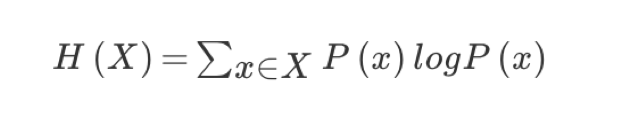

-

H的专业术语称之为信息熵单位为比特。

“谁是世界杯冠军”的信息量应该比5比特少特点重要 -

当这32支球队夺冠的几率相同时对应的信息熵等于5比特

-

只要概率发生任意变化信息熵都比5比特大

2.2.2 总结重要

- 信息和消除不确定性是相联系的

当我们得到的额外信息球队历史比赛情况等等越多的话那么我们猜测的代价越小猜测的不确定性减小

问题 回到我们前面的贷款案例怎么去划分可以利用当得知某个特征比如是否有房子之后我们能够减少的不确定性大小。越大我们可以认为这个特征很重要。那怎么去衡量减少的不确定性大小呢

2.3 决策树的划分依据之一------信息增益

2.3.1 定义与公式

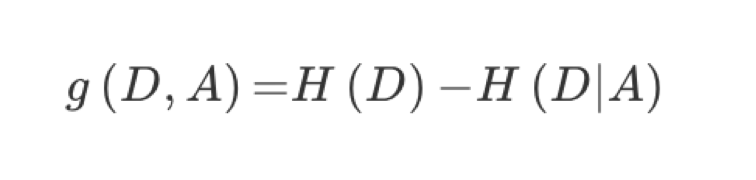

特征A对训练数据集D的信息增益g(D,A)定义为集合D的信息熵H(D)与特征A给定条件下D的信息条件熵**H(D|A)之差即公式为

公式的详细解释

注信息增益表示得知特征X的信息而息的不确定性减少的程度使得类Y的信息熵减少的程度

2.3.2 贷款特征重要计算

- 我们以年龄特征来计算

1、g(D, 年龄) = H(D) -H(D|年龄) = 0.971-[5/15H(青年)+5/15H(中年)+5/15H(老年]

2、H(D) = -(6/15log(6/15)+9/15log(9/15))=0.971

3、H(青年) = -(3/5log(3/5) +2/5log(2/5))

H(中年)=-(3/5log(3/5) +2/5log(2/5))

H(老年)=-(4/5og(4/5)+1/5log(1/5))

我们以A1、A2、A3、A4代表年龄、有工作、有自己的房子和贷款情况。

最终计算的结果g(D, A1) = 0.313, g(D, A2) = 0.324, g(D, A3) = 0.420,g(D, A4) = 0.363。所以我们选择A3 作为划分的第一个特征。这样我们就可以一棵树慢慢建立。

2.4 决策树的三种算法实现

当然决策树的原理不止信息增益这一种还有其他方法。但是原理都类似我们就不去举例计算。

- ID3

- 信息增益 最大的准则

- C4.5

- 信息增益比 最大的准则

- CART

- 分类树: 基尼系数 最小的准则 在sklearn中可以选择划分的默认原则

- 优势划分更加细致从后面例子的树显示来理解

2.5 决策树API

-

class sklearn.tree.DecisionTreeClassifier(criterion=’gini’, max_depth=None,random_state=None)

- 决策树分类器

- criterion:默认是’gini’系数也可以选择信息增益的熵’entropy’

- max_depth:树的深度大小

- random_state:随机数种子

-

其中会有些超参数max_depth:树的深度大小

- 其它超参数我们会结合随机森林讲解

-

sklearn.tree.export_graphviz() # 该函数能够导出DOT格式结合ycharm可以实现树结构的可视化

- tree.export_graphviz(estimator,out_file='tree.dot’,feature_names=[‘’,’’])

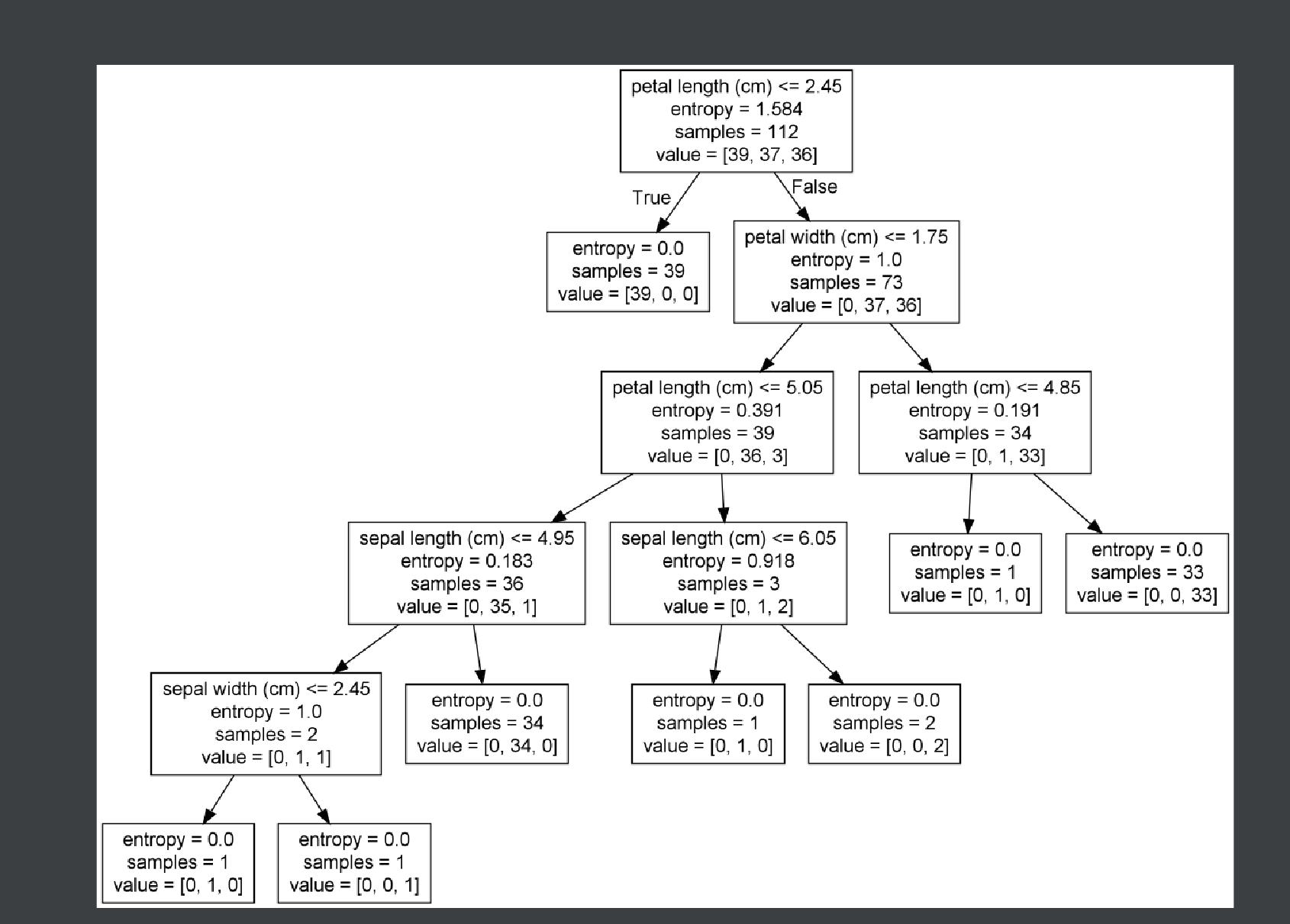

3、鸢尾花案例代码

from sklearn.model_selection import train_test_split

from sklearn.datasets import fetch_20newsgroups, load_iris

from sklearn.tree import DecisionTreeClassifier, export_graphviz

"""

用决策树对鸢尾花进行分类

:return:

"""

# 1获取数据集

iris = load_iris()

# 2划分数据集

x_train, x_test, y_train, y_test = train_test_split(iris.data, iris.target, random_state=22)

# 3决策树预估器

estimator = DecisionTreeClassifier(criterion="entropy", )

estimator.fit(x_train, y_train)

# 4模型评估

# 方法1直接比对真实值和预测值

y_predict = estimator.predict(x_test)

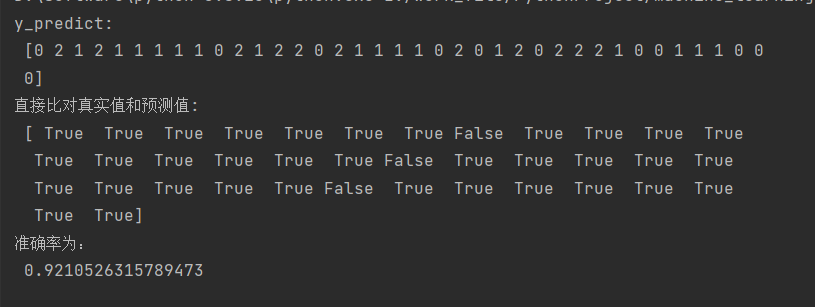

print("y_predict:\n", y_predict)

print("直接比对真实值和预测值:\n", y_test == y_predict)

# 方法2计算准确率

score = estimator.score(x_test, y_test)

print("准确率为\n", score)

# 可视化决策树

export_graphviz(estimator, out_file="iris_tree.dot", feature_names=iris.feature_names)

pycharm自带的dot文件的可视化

4、 决策树总结

- 优点

- 简单的理解和解释树木可视化。

- 缺点

- 决策树学习者可以创建不能很好地推广数据的过于复杂的树这被称为过拟合。

- 改进

- 减枝cart算法(决策树API当中已经实现随机森林参数调优有相关介绍)

- 随机森林

注企业重要决策由于决策树很好的分析能力在决策过程应用较多 可以选择特征

| 阿里云国内75折 回扣 微信号:monov8 |

| 阿里云国际,腾讯云国际,低至75折。AWS 93折 免费开户实名账号 代冲值 优惠多多 微信号:monov8 飞机:@monov6 |